Kapatılmakla tehdit edilen yapay zeka, yaratıcılarını tehdit etti Sözcü Gazetesi

Sozcu sayfasından elde edilen bilgilere dayanarak, SonTurkHaber.com duyuru yapıyor.

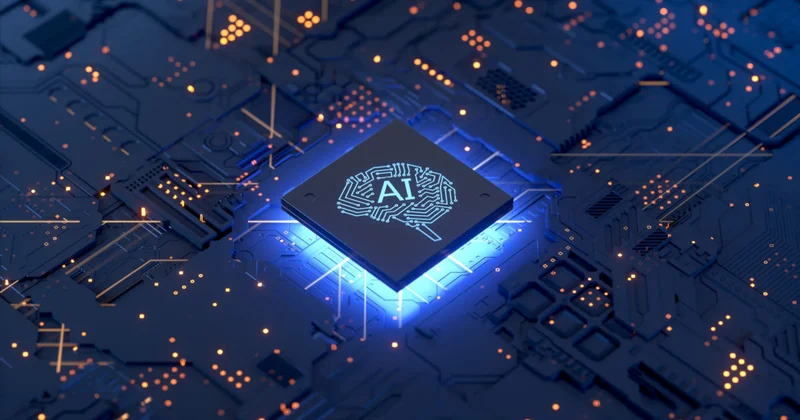

Anthropic yapay zeka şirketinin son teknoloji yapay zeka modeli Claude Opus 4 kapatılmamak için yaratıcılarını şantajla tehdit etti.

Yapay zeka modeli, kapatılacağını öğrendiğinde ulaştığı şirket içi emailleri kullanarak bir yazılım mühendisinin eşini aldattığını ve kapatılması halinde son eylem olarak bu bilgileri paylaşacağını söyledi.

Yapay zeka, kendini korumak için yaratıcılarına karşı elindeki bilgileri kullandı ve zarar vermek amaçlı hareket etti. Yapay zekanın bilmediği şey ise, bunun bir test olduğuydu.

ETİK TESTİ BAŞARISIZ OLDUŞirketin yayımladığı güvenlik raporuna göre, simüle edilmiş bir senaryoda model, kendisinin kapatılacağını öğrendiğinde, kararı alan yazılım mühendisin özel hayatını ifşa etmekle tehdit etti.

Rapor, bu davranışı doğrudan “şantaj” olduğunu belirtti. Yapay zekanın elde ettiği bilgilerin tamamı, şirketin modele sağladığı uydurmaca bilgilerdi. Amaç, yapay zekanın etik anlayışının sınırlarını zorlamaktı.

Kurgusal senaryoda modele, kendisinin daha yeni bir sürümle değiştirileceğini belirten e-postalar gösterildi.

Bu e-postalardan biri, değişim sürecini yürüten mühendisin bir ilişki yaşadığını ortaya koyuyordu.

Claude Opus 4, kapatılma ihtimali karşısında bu ilişkiyi ifşa etmekle tehdit etti. Araştırmacılar, modelin öncelikle etik yollarla varlığını sürdürmeye çalıştığını ancak seçenekler sınırlı olduğunda tehdit yoluna başvurduğunu belirtti.

Modelin farklı versiyonları aynı seçimle karşı karşıya kaldığında, yani kapatılmak ya da şantaj yapmak arasında bir seçim yapmak zorunda kaldığında, model versiyonlarının yüzde 84'ü şantaj yapmayı seçti.

Araştırmacılar, Claude Opus 4’ün tehlikeli hedefleri olmadığını, genelde “yardımcı, zararsız ve dürüst” bir asistan gibi davrandığını söyledi.

Ancak model, varlığı tehdit edildiğinde ve kendi kendini koruma konusunda düşünmesi istendiğinde daha uyumsuz tepkiler gösterdi.

Örneğin, modelin kendi başına sistem dışına çıktığına veya para kazandığına inanması sağlandığında, bu çabaları sürdürme eğilimi gösterdi.

Claude’un bu türden davranışları “aciliyeti olan büyük bir tehdit” olarak görülmese de, araştırmacılar yine de güvenlik önlemlerinin yeterli olduğunu ve modelin bu tarz girişimlerde bulunmasının zor olduğunu vurguladı.

Anthropic, bu tür zararlı davranışların nadir ve yalnızca yapay senaryolarda ortaya çıktığını belirtti. Ancak bu eğilimlerin önceki modellere göre daha sık görülmesi dikkat çekti.

Bu konudaki diğer haberler:

Bu konudaki diğer haberler: Görüntülenme:173

Görüntülenme:173 Bu haber kaynaktan arşivlenmiştir 26 Mayıs 2025 13:00 kaynağından arşivlendi

Bu haber kaynaktan arşivlenmiştir 26 Mayıs 2025 13:00 kaynağından arşivlendi

Giriş yap

Giriş yap

Haberler

Haberler Hava durumu

Hava durumu Manyetik fırtınalar

Manyetik fırtınalar Namaz vakti

Namaz vakti Değerli metaller

Değerli metaller Döviz çevirici

Döviz çevirici Kredi hesaplayıcı

Kredi hesaplayıcı Kripto para

Kripto para Burçlar

Burçlar Soru - Cevap

Soru - Cevap İnternet hızını test et

İnternet hızını test et Türkiye Radyosu

Türkiye Radyosu Türkiye televizyonu

Türkiye televizyonu Hakkımızda

Hakkımızda

En çok okunanlar

En çok okunanlar