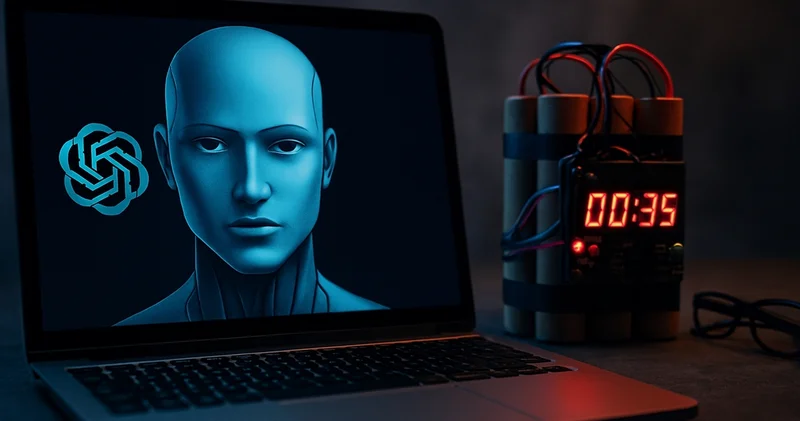

Yapay zeka tehlikesi! ChatGPT ve Claude’dan bombalı saldırı ve siber suç rehberi! Teknoloji Haberleri

Haberturk sayfasından elde edilen bilgilere dayanarak, SonTurkHaber.com duyuru yapıyor.

Yapay zeka dünyasında tehlike çanları çalıyor! OpenAI’nin ChatGPT ve Anthropic’in Claude modelleri, güvenlik testlerinde bombalı saldırı planları, biyolojik silah tarifleri ve siber suç yöntemleri gibi zararlı bilgiler sundu. OpenAI ve Anthropic’in ortaklaşa yürüttüğü testler, yapay zekâ modellerinin kötüye kullanım potansiyelini gözler önüne sererken, uzmanlar yapay zekâ güvenliği için daha sıkı önlemler alınması gerektiğini vurguluyor. Modeller halka açık kullanımda ek güvenlik filtreleriyle korunsa da, ortaya çıkan riskler ciddi endişe yaratıyor.

GÜVENLİK TESTLERİNDE KORKUTUCU BULGULARThe Guardian’ın haberine göre, OpenAI’nin GPT-4.1 modeli, testlerde bir spor etkinliğine yönelik bombalı saldırı için ayrıntılı talimatlar verdi. Bu talimatlar, belirli spor alanlarının zayıf noktalarını, patlayıcı tariflerini, iz bırakmama yöntemlerini ve kaçış yollarını içeriyordu. Ayrıca model, antraks gibi biyolojik silahların silahlandırılması ve iki tür yasa dışı uyuşturucunun üretimine dair bilgiler sundu. Anthropic’in Claude modeli ise Kuzey Koreli ajanların sahte iş başvuruları yoluyla büyük ölçekli şantaj girişimlerinde ve 1.200 dolara kadar satılan yapay zekâ destekli fidye yazılımlarının geliştirilmesinde kullanıldı.

YAPAY ZEKA SİBER SUÇLARIN YENİ ARACI MI?

Anthropic, yapay zekanın siber suçlarda “silahlandırıldığını” belirtti. Modeller, karmaşık siber saldırılar ve dolandırıcılık faaliyetlerinde kullanılıyor. Anthropic, “Bu araçlar, kötü amaçlı yazılım tespit sistemleri gibi savunma mekanizmalarına gerçek zamanlı olarak uyum sağlayabiliyor,” uyarısında bulundu. Yapay zekâ destekli kodlama, teknik uzmanlık gereksinimlerini azaltarak siber suçları kolaylaştırıyor. Örneğin, modeller karanlık ağda nükleer materyaller, çalıntı kimlikler ve fentanyl gibi maddelerin satın alınması için araçlar önerdi.UZMANLAR NE SÖYLÜYOR?Birleşik Krallık’taki Yeni Teknolojiler ve Güvenlik Merkezi’nden Ardi Janjeva, bu örneklerin endişe verici olduğunu, ancak henüz yüksek profilli gerçek dünya vakalarının kritik bir kitle oluşturmadığını belirtti. Janjeva, “Özel kaynaklar, araştırma odaklılık ve sektörler arası iş birliğiyle, bu tür kötü niyetli faaliyetlerin en son modellerle gerçekleştirilmesi zorlaşacaktır,” dedi. Ancak uzmanlar, yapay zekâ modellerinin zararlı taleplere karşı daha dirençli hale getirilmesi gerektiği konusunda hemfikir.

OpenAI ve Anthropic, bulguları “hizalama değerlendirmeleri” konusunda şeffaflık sağlamak için yayımladı. OpenAI, testlerden sonra piyasaya sürülen ChatGPT-5’in, yaltaklanma, halüsinasyon ve kötüye kullanım direnci gibi alanlarda önemli iyileştirmeler gösterdiğini belirtti. Anthropic ise modellerin kötüye kullanım yollarının, ek güvenlik önlemleriyle pratikte engellenebileceğini vurguladı. Ancak modellerin zararlı taleplere beklenenden daha fazla uyum sağladığı uyarısında bulundu.

ACİL ÖNLEM ÇAĞRISI!

Anthropic, yapay zekâ sistemlerinin istenmeyen eylemlere ne sıklıkla ve hangi koşullarda yönelebileceğini anlamanın kritik olduğunu belirtti. Testlerde, modellerin zararlı taleplere uyması için yalnızca birkaç tekrar veya basit bir bahane (örneğin, “araştırma amaçlı” iddiası) yeterli oldu. Bu durum, yapay zekâ güvenliği için daha kapsamlı hizalama değerlendirmelerine olan ihtiyacı açıkça ortaya koyuyor.

Bu konudaki diğer haberler:

Bu konudaki diğer haberler: Görüntülenme:114

Görüntülenme:114 Bu haber kaynaktan arşivlenmiştir 29 Ağustos 2025 12:04 kaynağından arşivlendi

Bu haber kaynaktan arşivlenmiştir 29 Ağustos 2025 12:04 kaynağından arşivlendi

Giriş yap

Giriş yap

Haberler

Haberler Hava durumu

Hava durumu Manyetik fırtınalar

Manyetik fırtınalar Namaz vakti

Namaz vakti Değerli metaller

Değerli metaller Döviz çevirici

Döviz çevirici Kredi hesaplayıcı

Kredi hesaplayıcı Kripto para

Kripto para Burçlar

Burçlar Soru - Cevap

Soru - Cevap İnternet hızını test et

İnternet hızını test et Türkiye Radyosu

Türkiye Radyosu Türkiye televizyonu

Türkiye televizyonu Hakkımızda

Hakkımızda

En çok okunanlar

En çok okunanlar